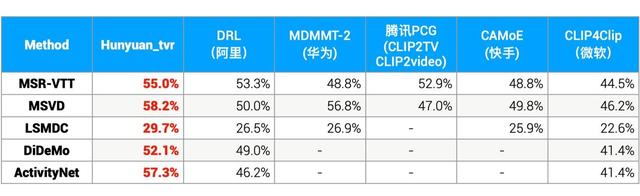

4月21日,腾讯对外正式宣布,腾讯“混元”AI大模型在MSR-VTT,MSVD,LSMDC,DiDeMo和ActivityNet 五大跨模态视频检索数据集榜单中先后取得第一名的成绩,实现了该领域的大满贯。

特别是在MSR-VTT榜单上,“混元”AI大模型将文字-视频检索精度提高到55%,领先第二名1.7%,位居行业第一。

图1:各模型方法在5个公开数据集上指标对比

据悉,这是腾讯首次对外披露“混元”AI大模型的研发进展,该模型包含但不限于:计算机视觉、自然语言处理、多模态内容理解、文案生成、文生视频等多个方向的超大规模AI智能模型。“混元”AI大模型基于腾讯太极机器学习平台进行研发,借助GPU算力,实现快速的算法迭代和模型训练。

近年来,图文及视频内容在互联网内容中所占比例不断提高,如何更细粒度的理解视频内容,融合多个模态的特征信息,成为跨模态视频检索技术的“重中之重”,在AI领域有深入研究的科技公司纷纷开始在该领域布局和投入。

MSR-VTT、MSVD、 LSMDC、DiDeMo、ActivityNet是行业内最具权威性的五大跨模态视频检索数据集榜单,主办单位包括微软、加州大学伯克利、阿卜杜拉国王科技大学等,检索库涵盖了日常生活的诸多场景,已经成为科技企业和研究机构展现AI大模型技术实力的重要的竞技场之一。

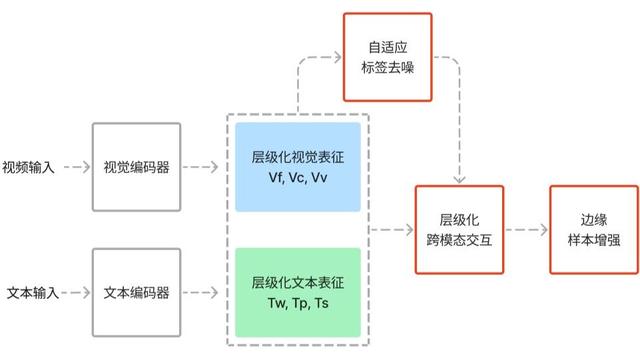

经过多年研究,腾讯广告多媒体AI团队以层次化、细粒度、高精度为目标,提出了“混元“跨模态视频检索AI大模型(简称HunYuan_tvr)。与业界其他大模型相比,团队首创了层级化跨模态技术,可将视频和文本等跨模态数据分别做拆解,通过相似度分析,综合考量并提取视频和文本之间层次化的语义关联。

图2:HunYuan_tvr模型架构示意图

这种“先分层、再关联、后检索”的交互方法,一方面可捕捉多模态(文字、视频)内部的细粒度语义信息,另一方面也能有效地检索跨模态数据间的关联性,从而大大提升了检索的精确度。

精确度的大幅提升代表国内在多模态内容理解方面的技术研究取得了新突破,这意味着计算机将进一步贴近人类对视频内容的理解与认知能力。同时,“混元”AI大模型的优越性及泛化性得到了验证,将为AI学术研究和工业级应用带来更多长期价值。

目前,“混元“AI大模型已被广泛应用到广告创作、广告检索、广告推荐等腾讯业务场景中。一方面,该模型能够帮助广告创作者和腾讯平台方预测视频内容与消费者群体之间的兴趣关联,提升创作效率;另一方面,能够有效提升广告推荐的精准度,让内容搜索和匹配更加精确,有效优化用户体验。